‘Hớ hênh’ để lộ 512.000 dòng mã nguồn: Khi gã khổng lồ AI Anthropic bị chính ưu thế tốc độ ‘phản lưới nhà’

Ngành công nghệ đang rúng động vì vụ việc của Anthropic.

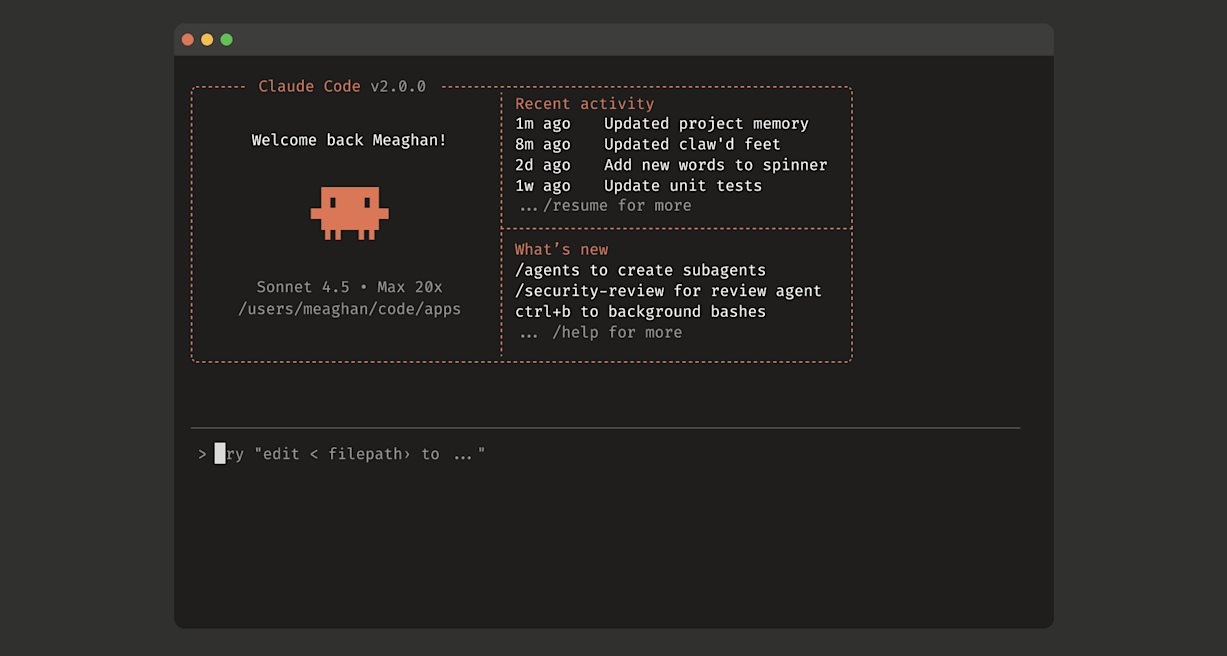

Chỉ sau một đêm, công cụ hỗ trợ lập trình bí mật và quyền lực nhất của Anthropic là Claude Code đã bị phơi bày toàn bộ “nội thất” trước công chúng. Từ những tính năng chưa ra mắt cho đến bảng biểu theo dõi mức độ… văng tục của người dùng, tất cả đã tạo nên một bữa tiệc chia sẻ dữ liệu lớn chưa từng có, đặt ra dấu hỏi lớn về tính bảo mật trong kỷ nguyên AI “vội vã”.

Vào lúc 4 giờ sáng ngày thứ Ba, khi phần lớn thế giới còn đang chìm trong giấc ngủ, anh Sigrid Jin, sinh viên 25 tuổi tại Đại học British Columbia, đã bị đánh thức bởi hàng loạt thông báo dồn dập trên điện thoại. Một vụ rò rỉ chấn động vừa xảy ra: 512.000 dòng mã nguồn của Claude Code, niềm tự hào của Anthropic, đã bị đăng tải công khai do sai sót từ phía con người.

Không bỏ lỡ thời cơ, anh Jin cùng cộng sự Yeachan Heo đã thực hiện một cuộc “giải phẫu” thần tốc. Chỉ với 2 người, 10 công cụ AI hỗ trợ (OpenClaws), một chiếc MacBook Pro và vài giờ đồng hồ, họ đã tái tạo thành công mã nguồn của tác nhân AI đình đám này sang ngôn ngữ Python và chia sẻ nó với toàn thế giới dưới cái tên "Claw Code".

Lỗi 'vỡ lòng' của những bộ óc thiên tài

Sự việc bắt đầu khi Chaofan Shou, Giám đốc công nghệ của Fuzzland, phát hiện Anthropic vô tình xuất bản công khai mã nguồn của Claude Code. Bản rò rỉ chứa đựng chi tiết cách thức hoạt động của công cụ, các bài kiểm tra tính năng mới và cả lộ trình phát triển trong tương lai.

Dù Anthropic đã nhanh chóng can thiệp và yêu cầu GitHub gỡ bỏ hơn 8.000 bản sao, nhưng "con quỷ đã thoát khỏi bình". Những đoạn mã này hiện vẫn đang lan truyền mạnh mẽ trong các máy chủ Discord kín và các liên kết lưu trữ trực tuyến.

Tính đến chiều thứ Tư, dự án tái tạo "Claw Code" của Jin đã thu về hơn 105.000 sao và 95.000 lượt fork trên GitHub, một con số kỷ lục cho thấy sự khao khát của cộng đồng đối với công nghệ này.

Điều khiến giới chuyên gia kinh ngạc nhất không phải là quy mô vụ rò rỉ, mà là cách nó xảy ra. Delip Rao, nhà nghiên cứu AI từng làm việc tại Amazon và Twitter, nhận định rằng đây là một sai lầm ở mức độ "nghiệp dư" (noob-level) đối với một công ty quy định khắt khe và sở hữu những nhân sự thông minh nhất thế giới như Anthropic.

Giải thích về sự cố này, Boris Cherny, cha đẻ của Claude Code tại Anthropic, thừa nhận đây hoàn toàn là lỗi do con người trong quy trình triển khai có một vài bước thủ công không được thực hiện đúng cách. Tuy nhiên, ông khẳng định sẽ không có ai bị sa thải vì "đây là một sai lầm trung thực và nó vẫn thường xảy ra".

Cuộc rò rỉ này giống như một lần "nội soi" hiếm hoi vào chiến lược sản phẩm của Anthropic. Những người đam mê công nghệ đã nhanh chóng bóc tách và phát hiện ra hàng loạt thông tin thú vị.

Thứ nhất là sự xuất hiện của các mô hình chưa công bố như Opus 4.7, Sonnet 4.8 cùng những mật danh như "Capybara" hay "Tengu". Đặc biệt, tính năng "KAIROS" – một tác nhân AI chạy 24/7 để tạo nhật ký hàng ngày và xử lý công việc trước khi người dùng kịp yêu cầu – đã gây chú ý lớn.

Thứ hai, một phát hiện mang tính hài hước nhưng đầy thực tế là biểu đồ "fucks" (fucks chart). Tác nhân AI này sẽ ghi lại những từ ngữ thô tục mà người dùng sử dụng khi cáu gắt với AI để đánh giá mức độ hài lòng của trải nghiệm. Boris Cherny xác nhận đây là cách họ theo dõi liệu người dùng có đang gặp khó khăn hay không.

Thứ ba là xu hướng cá nhân hóa công cụ lập trình với "thú cưng lập trình" (coding pets). Một người dùng Reddit cho biết đã thấy dấu vết của một thực thể giống như Tamagotchi ngồi cạnh hộp nhập liệu và phản ứng với các dòng mã của lập trình viên.

Sự trỗi dậy của 'dân chủ hóa' công nghệ

Đối với Sigrid Jin, ý nghĩa lớn nhất của vụ rò rỉ này không nằm ở khía cạnh pháp lý hay bảo mật, mà là sự dân chủ hóa các công cụ lập trình đỉnh cao.

"Những người không rành về kỹ thuật đang sử dụng các tác nhân này để xây dựng những thứ thực sự có giá trị. Chúng ta đang nói về những bác sĩ tim mạch tự tạo ứng dụng chăm sóc bệnh nhân hay các luật sư tự động hóa quy trình phê duyệt giấy phép. Đây thực sự là một bữa tiệc chia sẻ khổng lồ", Jin chia sẻ với tờ Business Insider.

Sự việc cũng phơi bày một thực tế mỉa mai: Trong khi các công ty AI thường xuyên bị cáo buộc sử dụng tài liệu có bản quyền để huấn luyện mô hình, thì chính họ lại đang phải chật vật bảo vệ tài sản trí tuệ của mình trước sự tò mò của cộng đồng.

Thậm chí, các đối thủ cạnh tranh như xAI của Elon Musk còn "đổ thêm dầu vào lửa" khi gửi tặng tín dụng Grok cho Jin để ủng hộ anh tiếp tục xây dựng các dự án mã nguồn mở từ bản rò rỉ này.

Vụ việc của Anthropic là lời cảnh tỉnh cho phương châm "di chuyển nhanh và phá vỡ mọi thứ" (move fast and break things) trong kỷ nguyên AI. David Borish, chiến lược gia AI tại Trace3, cho rằng không có cách nào để đảm bảo các bước kiểm tra an ninh chặt chẽ khi các công ty đang bị cuốn vào cuộc đua ra mắt tính năng mới với tốc độ chóng mặt.

Tuy nhiên, thay vì chọn cách chậm lại, phản ứng của Anthropic lại là... tăng tốc hơn nữa. Boris Cherny tin rằng giải pháp cho những sai sót của con người chính là tự động hóa nhiều hơn và để chính Claude kiểm tra các kết quả đầu ra.

Vụ rò rỉ Claude Code có thể là một vận hạn đối với Anthropic về mặt hình ảnh và bảo mật, nhưng đối với thế giới lập trình, nó đã mở ra một "workflow revelation" (sự khai sáng về quy trình làm việc). Nó chứng minh rằng với sự hỗ trợ của AI, việc tái tạo và phát triển các công cụ phức tạp giờ đây chỉ còn tính bằng giờ thay vì bằng tháng, biến những bí mật công nghệ trở thành tài sản chung của cộng đồng chỉ sau một cú nhấp chuột sai lầm.

*Nguồn: BI, Fortune